Yapay Zeka

Yapay Zeka (AI), makinelerin insanlardan çok daha iyi “gaydar” olabileceğini düşündüren yeni araştırmalara göre, insanların gey olup olmadıklarını yüzlerinin fotoğraflarından doğru bir şekilde tahmin edebilir.

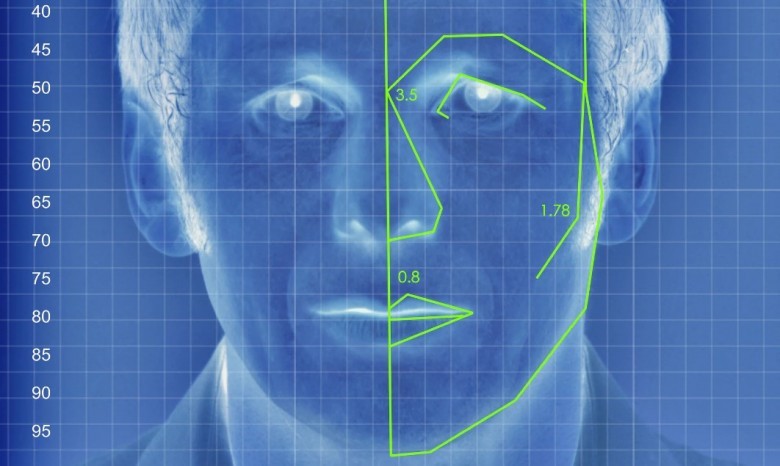

Stanford Üniversitesi‘nden yapılan araştırmada; gay ve normal erkekler arasında %81 oranında ve kadınların %74’ünü doğru bir şekilde ayırt edebildiğini tespit eden bir bilgisayar algoritmasının, cinsel yönelimin biyolojik kökenleri, yüz tanıma teknolojisinin etiği hakkında soru işaretleri yarattı. Bu tür bir yazılımın insanların gizliliğini ihlal etme veya LGBT karşıtı amaçlarla istismar edilmesi potansiyeli olabileceği gündeme geldi.

İlk olarak Economist‘te yayınlanan daha sonra the Journal of Personality and Social Psychology Dergisinde yayınlanan araştırmada test edilen makine istihbaratı, erkeklerin ve kadınların ABD’deki bir web sitesine kamuya açıkladığı 35.000’den fazla yüz görüntüsünün bir örneğini temel aldı. Araştırmacılar Michal Kosinski ve Yilun Wang, görselleri büyük bir veri kümesine dayalı olarak analiz etmeyi öğrenen sofistike bir matematik sistemi anlamına gelen “derin sinir ağları” kullanarak görüntülerden özellikleri tespit ettiler.

Araştırma, gay erkeklerin ve kadınların “cinsiyet-atipik” özelliklere, ifadelere ve “tımar stillerine” sahip olma eğilimi gösterdiklerini, aslında gey erkeklerin daha kadınsı olduklarını ve tam tersini ifade etti. Veriler aynı zamanda, gay erkeklerin daha dar çeneler, daha uzun burunlar ve normal erkeklerden daha fazla alnı olduğu; eşcinsel kadınların normal kadınlara kıyasla daha büyük çeneleri ve daha küçük alnları olduğu gibi bazı eğilimleri tespit etti.

Araştırmada insanlar ise, oryantasyonu algoritmadan çok daha kötü yaptı ve oryantasyonda erkeklerin sadece %61’ini ve kadınların %54’ünü doğru olarak tespit etti. Yazılım kişi başı beş görüntü gözden geçirdiğinde daha da başarılıydı; erkeklerin %91’ini erkek, kadınların %83’ünü doğru tahmin etti. Yazarlar genel olarak bunun, “yüzler cinsel yönelim hakkında insan beyni tarafından algılanıp yorumlanandan çok daha fazla bilgi içeriyor” anlamına geldiğini yazdı.

Makaleler, bulguların cinsel yönelimin doğumdan önce belirli hormonlara maruz kalıştan kaynaklandığını, yani insanların eşcinsel doğduğunu ve queer olmanın bir tercih olmadığı teorisine “güçlü destek” sunduğunu ileri sürdü. Makinenin kadınlar için daha düşük başarı oranı da kadın cinsel yöneliminin daha akıcı olduğu fikrini destekleyebilir.

Bulgular cinsiyet ve cinsellik söz konusu olduğunda açık sınırlar içeriyor olsa da – renkli insanlar çalışmaya dahil edilmemişti ve transseksüel veya biseksüel insanlar göz önüne alınmadığında – Yapay Zeka (AI) için etkileri çok büyük ve endişe vericiydi. Araştırmacılar, sosyal medya sitelerinde ve hükümet veritabanlarında depolanan milyarlarca yüz görüntüsünün insanların cinsel yönelimlerini rızaları olmadan tespit etmek için kullanılabileceğini belirtti.

Teknolojiyi kullanan eşlerin şüphelenilen partnerlerde eşlerini hayal kırıklığına uğratabilir, ya da gençler algoritmayı kendileri veya akranları üzerinde kullanabilirler. Daha da korkutucu bir şekilde, LGBTT bireyleri kovuşturmaya devam eden hükümetler, teknolojiyi hipotetik olarak dışarı çıkarıp hedef kitlelere karşı kullanabilirler. Bu da, bu tür bir yazılımın oluşturulması ve zararlı uygulamaları teşvik edebileceği endişeleri göz önüne alındığında, tartışmalı olduğunu ortaya koyar.

Ancak yazarlar, teknolojinin zaten var olduğunu ve yeteneklerin, hükümetlerin ve şirketlerin gizlilik risklerini, güvenlik önlemleri, yönetmeliklerin gerekliliğini proaktif olarak değerlendirebilecekleri şekilde ortaya çıkarmak için önemli olduğunu savundu.

Gaydar bilimini araştıran Toronto Üniversitesi psikoloji profesörü olan Nick Rule yayınladığı araştırmasında “Kesinlikle huzursuzluk veriyor. Yeni çıkan teknolojiler gibi yanlış ellere geçerse, kötü amaçlarla kullanılabilir. İnsanları görünüşlerine dayandırarak profil oluşturmayı başarabiliyorsanız, onları tanımlamak ve onlara korkunç şeyler yapmak düşüncesi gerçekten kötü” dedi.

Rule, bu teknolojiyi geliştirme ve test etmenin hala önemli olduğunu savundu: “Yazarların burada yaptıkları, bunun ne kadar güçlü olabileceği konusunda çok cesur bir ifade sergilemeleridir… Şimdi korumaya ihtiyacımız olduğunu biliyoruz.”

Stanford araştırmasında yazarlar; yapay zekanın, yüz özellikleri ile siyasi görüş, psikolojik koşullar veya kişilik gibi bir dizi diğer fenomen özellikler arasındaki bağlantıları keşfetmek için kullanılabileceğini de kaydetti.

Bu tür bir araştırma, insanları suç işleyeceklerini öngören bilim kurgu filmi Azınlık Raporu gibi senaryolar için potansiyel konusunda endişeleri de beraberinde getiriyor.

Yüz tanıma şirketi olan Kairos’un CEO’su Brian Brackeen, “AI size yeterli veri bulunan herkes hakkında bir şey söyleyebilir” dedi. “Asıl soru biz bilmek istiyor muyuz?”

Cinsel yönelim hakkındaki Stanford verilerinin “şaşırtıcı derecede doğru” olduğunu belirten Brackeen, makinenin öğrenmesinin kötüye kullanılmasını önlemek için gizlilik ve araçlara odaklanılması gerektiğini söyledi.

Rule ise, AI’nın bir makinenin yüzleri yorumlaması üzerine aktif olarak ayrımcılık yapmak için kullanıldığı konusunda spekülasyon yaptı: “Hepimiz toplu olarak ilgilenmeliyiz”.